GPT-5.4 und der Büroalltag: Was sich für Anwender wirklich verändert hat

Was GPT-5.4 für den Büroalltag verändert: Computer Use, Excel-Integration und warum kompetente Anwender jetzt wichtiger sind als je zuvor.

Vergangene Woche habe ich eine Teilnehmerin in einem meiner Trainings gefragt, was sich durch das neue GPT-5.4 für sie verändert hat. Ihre ehrliche Antwort: „Nichts, glaube ich." Sie nutzt ChatGPT seit fast zwei Jahren. Sie schreibt damit E-Mails vor, fasst Protokolle zusammen, lässt sich Textbausteine für Angebote formulieren. Und genau das macht sie mit GPT-5.4 genauso wie vorher mit GPT-4o. Der Modellwechsel war für sie unsichtbar – weil sie nie erfahren hat, was das Werkzeug inzwischen eigentlich kann.

Ich erzähle das nicht, um diese Teilnehmerin bloßzustellen. Im Gegenteil: Sie steht stellvertretend für die Mehrheit. OpenAI hat am 5. März 2026 das leistungsfähigste Sprachmodell auf den Markt gebracht, das je öffentlich verfügbar war. Es kann Bildschirme lesen, Maus und Tastatur bedienen, direkt in Excel-Tabellen arbeiten und mehrstufige Aufgaben eigenständig planen. Und die meisten Büroanwender tippen weiterhin „Fasse mir das zusammen" in ein Chatfenster. Die Frage ist nicht, ob GPT-5.4 den Büroalltag verändern kann. Die Frage ist, warum es das bei den meisten noch nicht tut.

Was GPT-5.4 tatsächlich anders macht

Um zu verstehen, warum dieses Update anders ist als die vielen kleinen Verbesserungen der letzten Monate, muss man einen Schritt zurücktreten. Die bisherige Entwicklung von ChatGPT lief im Kern immer gleich ab: Das Modell wurde klüger, schneller, genauer. GPT-4o war besser als GPT-4, GPT-5 war besser als GPT-4o. Aber die Art der Interaktion blieb dieselbe – man tippt eine Frage, bekommt eine Antwort, kopiert sie irgendwohin. ChatGPT war ein Gesprächspartner, kein Werkzeug.

GPT-5.4 bricht mit diesem Muster an zwei entscheidenden Stellen. Erstens: Computer Use. Das Modell kann jetzt Bildschirminhalte interpretieren und über Maus- und Tastatureingaben mit Software interagieren – es sieht, was auf dem Monitor passiert, und kann darauf reagieren. OpenAI hat dafür den OSWorld-Benchmark veröffentlicht, bei dem GPT-5.4 mit 75 Prozent Erfolgsrate abschneidet. Zum Vergleich: Der menschliche Durchschnitt liegt bei 72,4 Prozent. Man kann darüber streiten, wie aussagekräftig ein einzelner Benchmark ist. Aber die Richtung ist unmissverständlich: ChatGPT kann jetzt Dinge tun, nicht nur darüber reden.

Die zweite Neuerung betrifft die Art, wie GPT-5.4 an komplexe Aufgaben herangeht. Im sogenannten Thinking-Modus zeigt das Modell seinen Denkplan, bevor es anfängt zu arbeiten. Das klingt nach einem kleinen Feature, verändert aber die Dynamik erheblich. Bisher war die Interaktion mit ChatGPT ein Glücksspiel: Man schickt einen Prompt ab und hofft, dass das Ergebnis brauchbar ist. Jetzt kann man den Plan korrigieren, bevor das Modell ihn ausführt. Für jemanden, der ChatGPT ernsthaft in seinen Arbeitsablauf integrieren will, ist das ein qualitativer Sprung – nicht weil die Antworten besser sind, sondern weil man erstmals mitsteuern kann.

ChatGPT direkt in Excel: Der stille Paradigmenwechsel

Wenn ich in meinen Trainings frage, wo im Arbeitsalltag die meiste Zeit verloren geht, kommt eine Antwort zuverlässig unter den Top drei: Tabellenkalkulation. Nicht weil Excel ein schlechtes Werkzeug wäre, sondern weil die meisten Menschen es falsch benutzen. Sie kopieren Daten manuell zwischen Sheets, bauen Formeln durch Ausprobieren statt durch Verständnis, und verbringen Stunden damit, Pivot-Tabellen zu formatieren, die am nächsten Tag schon wieder veraltet sind.

OpenAI hat parallel zum Modell-Launch ein ChatGPT-Add-in für Excel veröffentlicht, das als Sidebar direkt im Spreadsheet lebt. Die Idee dahinter ist denkbar einfach: Statt eine Formel zu googlen, beschreibt man in natürlicher Sprache, was man braucht, und ChatGPT setzt es direkt in der Tabelle um. Das klingt nach einem netten Gimmick, bis man es in Aktion sieht. In einer Demo für ein mittelständisches Unternehmen letzte Woche habe ich einem Controlling-Team gezeigt, wie ChatGPT aus einem unstrukturierten Datensatz ein vollständiges Szenario-Modell mit drei Varianten erstellt hat – inklusive bedingter Formatierung und Pivot-Zusammenfassungen. Der Vorgang hat keine vier Minuten gedauert. Der Controller, der normalerweise für so etwas einen halben Tag einplant, hat danach eine Weile geschwiegen.

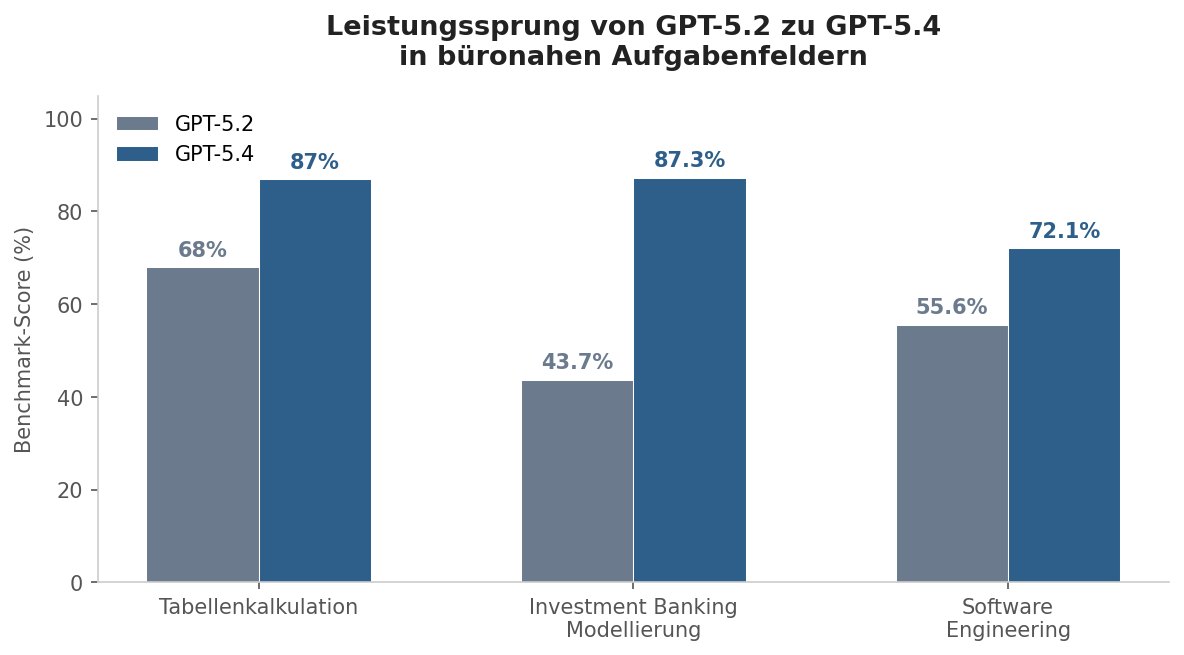

Auf dem Spreadsheet-Modelling-Benchmark erreicht GPT-5.4 einen Score von 87 Prozent gegenüber 68 Prozent beim Vorgänger GPT-5.2. Das ist kein marginaler Fortschritt. Das ist der Unterschied zwischen einem Tool, das bei Formeln helfen kann, und einem, das eigenständig funktionierende Finanzmodelle baut. Ob man das bedrohlich oder befreiend findet, hängt vermutlich davon ab, wie viel der eigenen Arbeitszeit bisher in genau dieser Art von Tabellenarbeit steckt.

Die Zahlen hinter dem Modellwechsel

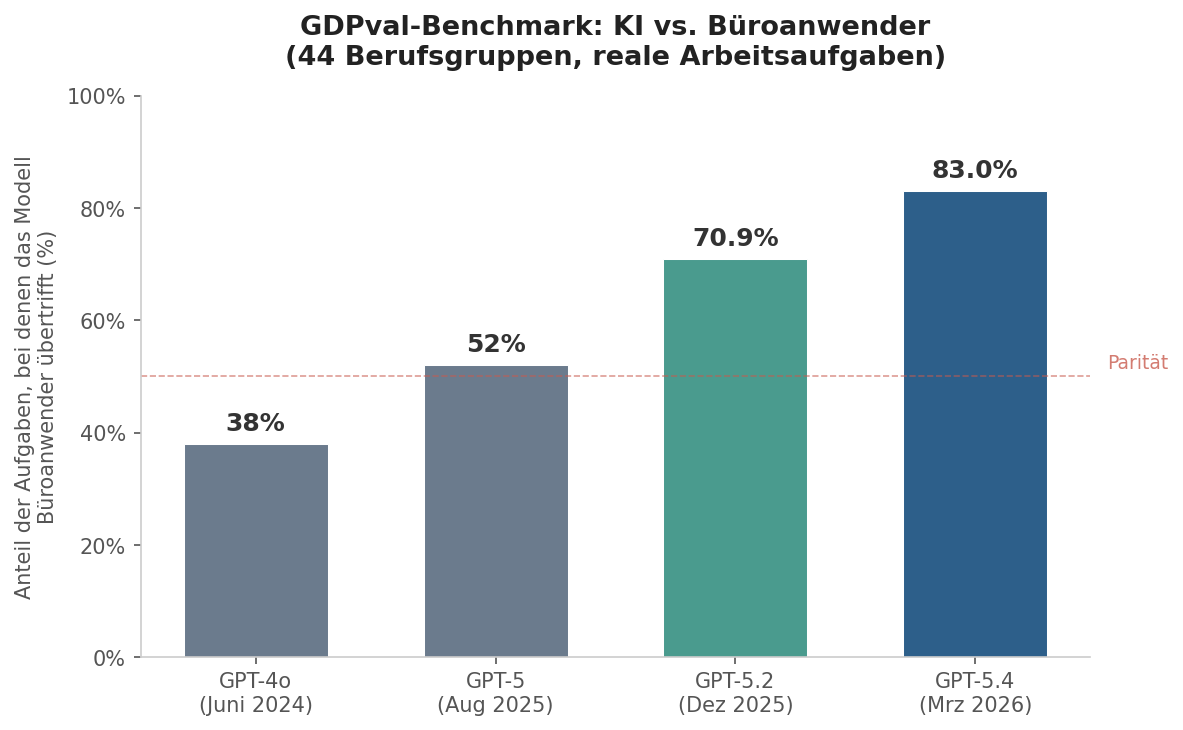

OpenAI hat mit GPT-5.4 einen hauseigenen Benchmark namens GDPval vorgestellt, der das Modell nicht an akademischen Aufgaben misst, sondern an realen Tätigkeiten aus 44 verschiedenen Berufsgruppen – darunter kaufmännische Sachbearbeitung, Finanzanalyse, Rechtsrecherche und technische Dokumentation. GPT-5.4 übertrifft dort in 83 Prozent der Fälle die menschliche Vergleichsgruppe. Bei GPT-5.2 waren es noch 71 Prozent, bei GPT-5 deutlich weniger.

Man muss solche Zahlen mit Vorsicht lesen. Ein Benchmark, den das Unternehmen selbst entwickelt hat, das auch das Modell verkauft, ist kein unabhängiges Gütesiegel. Und „übertrifft Büroanwender" heißt nicht, dass das Modell einen Sachbearbeiter ersetzen kann – es heißt, dass es bei isolierten Aufgaben schneller oder präziser zum Ergebnis kommt. Die Einordnung, ob das Ergebnis im Gesamtkontext Sinn macht, bleibt menschliche Arbeit.

Trotzdem ist der Trend unmissverständlich. Besonders auffällig sind die Sprünge in spezifischen Disziplinen: Im Investment-Banking-Benchmark kletterte die Leistung von 43,7 Prozent bei GPT-5 auf 87,3 Prozent bei GPT-5.4. Bei der Tabellenkalkulation von 68 auf 87 Prozent. OpenAI gibt außerdem an, dass GPT-5.4 ein Drittel weniger Falschaussagen produziert als sein Vorgänger und 18 Prozent weniger fehlerhafte Antworten insgesamt. Für den Büroalltag bedeutet das: Das Vertrauen, das man den Ergebnissen entgegenbringen darf, wächst – aber es ersetzt die Prüfung nicht.

Was das am Schreibtisch bedeutet

Wer sich durch die Benchmark-Zahlen gearbeitet hat, fragt sich vielleicht: Schön und gut, aber was ändert sich konkret an meinem Montagmorgen? Ich versuche es an drei Szenarien festzumachen, die ich in den letzten Tagen mit Kunden durchgespielt habe.

Szenario eins: Ein Vertriebsleiter bekommt eine Excel-Datei mit den Quartalszahlen aller Regionen. Früher hätte er die Zahlen selbst sortiert, Formeln geschrieben, ein paar Diagramme gebaut und das Ergebnis in eine PowerPoint kopiert. Mit GPT-5.4 in Excel beschreibt er, was er sehen will – „Zeig mir die drei schwächsten Regionen mit Vorjahresvergleich und markiere alle mit mehr als zehn Prozent Rückgang" – und bekommt das Ergebnis direkt in seiner Tabelle. Die Arbeit, die vorher anderthalb Stunden gedauert hat, ist in zehn Minuten erledigt. Nicht weil die KI schlauer rechnet, sondern weil der Mensch nicht mehr zwischen drei Anwendungen hin- und herkopieren muss.

Szenario zwei: Eine Assistentin soll aus zwölf verschiedenen PDF-Angeboten eine Vergleichsmatrix erstellen. Mit dem Thinking-Modus zeigt ChatGPT vorab, wie es die Aufgabe angehen will – welche Kriterien es extrahiert, wie die Tabelle aufgebaut wird, ob es Rückfragen gibt. Sie korrigiert den Plan („Nimm auch die Zahlungsbedingungen mit rein"), und ChatGPT führt den Rest aus. Das ist kein futuristisches Szenario. Das funktioniert heute, mit einer Team-Lizenz.

Szenario drei – und hier wird es für mich persönlich am interessantesten: Ein Projektmanager nutzt den agentischen Modus, um wöchentlich einen Statusbericht zu erstellen. ChatGPT liest die letzten Chat-Nachrichten im Projektkanal, zieht die offenen Tickets aus dem Projektmanagement-Tool und erstellt einen strukturierten Bericht mit Ampelsystem. Der Projektmanager prüft das Ergebnis und schickt es ab. Was vorher freitags regelmäßig liegen blieb, weil die Zeit fehlte, passiert jetzt in drei Minuten.

Das eigentliche Problem sitzt nicht im Modell

Ich könnte jetzt seitenlang die neuen Fähigkeiten aufzählen. Aber das wäre am Kern vorbei. Denn die unbequeme Beobachtung aus meiner Trainings- und Beratungspraxis ist eine andere: Die meisten Unternehmen scheitern nicht an den Grenzen des Modells. Sie scheitern daran, dass ihre Mitarbeitenden die vorhandenen Möglichkeiten nicht kennen.

In einer typischen Schulungsgruppe mit fünfzehn Teilnehmern gibt es vielleicht zwei oder drei, die über das einfache Frage-Antwort-Muster hinausgekommen sind. Der Rest nutzt ChatGPT als bessere Suchmaschine oder als Textgenerator für Standardaufgaben. Canvas kennen die wenigsten. Den agentischen Modus haben die meisten noch nie ausprobiert. Und die Excel-Integration? Von der haben die Teilnehmer in meinem letzten Training am 10. März – fünf Tage nach dem Launch – noch nichts gehört.

Das ist kein Vorwurf an die Mitarbeitenden. Es ist ein Versäumnis der Organisationen, die ein mächtiges Werkzeug bereitstellen, ohne ihre Leute zu befähigen, es sinnvoll einzusetzen. Und je leistungsfähiger die Modelle werden, desto größer wird die Kluft zwischen dem, was möglich wäre, und dem, was tatsächlich genutzt wird. GPT-5.4 verschärft dieses Problem, weil es den Abstand zwischen Können und Nutzen weiter vergrößert.

Es gibt noch eine zweite Dimension, die selten angesprochen wird: Mit steigender Leistungsfähigkeit sinkt die Fehlertoleranz. Wenn ein Modell in 83 Prozent der Fälle besser arbeitet als der Mensch, aber die restlichen 17 Prozent ungeprüft durchgehen – dann hat man kein Produktivitätswunder, sondern ein Qualitätsproblem. Die Fähigkeit, KI-Ergebnisse kritisch einzuordnen, wird mit jedem Modellupdate wichtiger, nicht unwichtiger. Wer das für ein Paradox hält, hat noch nicht erlebt, wie ein perfekt formatierter GPT-5.4-Bericht mit einer subtil falschen Zahl durch drei Hierarchieebenen wandert, ohne dass jemand stutzig wird.

Was Unternehmen jetzt tun sollten

Der Reflex vieler Organisationen bei einem großen Modellupdate ist abzuwarten. Man liest ein paar Artikel, nickt anerkennend und geht zurück zum Tagesgeschäft. Das war bei GPT-4 nachvollziehbar, weil die Möglichkeiten noch abstrakt wirkten. Bei GPT-5.4 ist das anders. Die neuen Fähigkeiten sind konkret, sie betreffen den täglichen Umgang mit den Werkzeugen, die in jedem Büro stehen, und sie sind sofort nutzbar.

Wer ChatGPT im Unternehmen eingeführt hat – ob über Team-, Enterprise- oder Pro-Lizenzen –, sollte jetzt drei Dinge tun. Erstens: die eigene KI-Richtlinie überprüfen. Computer Use, Excel-Integration und der agentische Modus werfen neue Fragen auf, die in den meisten bestehenden Richtlinien nicht adressiert sind. Darf ChatGPT auf Unternehmensdaten in Excel zugreifen? Unter welchen Bedingungen? Wer entscheidet, ob der agentische Modus für eine Aufgabe eingesetzt wird? Diese Fragen brauchen klare Antworten, bevor einzelne Mitarbeitende sie für sich selbst beantworten.

Zweitens: ein Update-Training anbieten. Nicht ein einstündiges Webinar, in dem jemand die Release Notes vorliest. Sondern eine praktische Einheit, in der Mitarbeitende die neuen Funktionen an ihren eigenen Aufgaben ausprobieren. Der Unterschied zwischen „Ich habe gehört, ChatGPT kann jetzt Excel" und „Ich habe gesehen, wie mein monatlicher Report in drei Minuten fertig war" ist der Unterschied zwischen Wissen und Handeln.

Drittens – und das mag überraschen – sollten Unternehmen gezielt in Prüfkompetenz investieren. Je besser die Ergebnisse von ChatGPT werden, desto schwieriger wird es, die Fehler zu erkennen. Ein Modell, das in 83 Prozent der Fälle korrekt liegt, erzeugt ein trügerisches Grundvertrauen. Die verbleibenden 17 Prozent zu identifizieren, erfordert Fachwissen und eine kritische Haltung, die sich nicht von selbst einstellt. Sie muss trainiert werden.

Häufig gestellte Fragen

Unsere Mitarbeiter nutzen noch GPT-4o – lohnt sich der Wechsel auf GPT-5.4 überhaupt?

Der Unterschied ist erheblich, aber er entfaltet sich nur, wenn Mitarbeitende wissen, wie sie die neuen Fähigkeiten nutzen. GPT-5.4 macht deutlich weniger Fehler, kann direkt in Excel arbeiten und mehrstufige Aufgaben eigenständig ausführen. Wer aber weiterhin nur einfache Fragen stellt, merkt kaum einen Unterschied. chatgpt-trainings.de bietet gezielte Schulungen, die zeigen, welche neuen Workflows durch GPT-5.4 möglich werden – und wie sich das in konkreter Zeitersparnis niederschlägt.

Wie überzeuge ich die Geschäftsleitung, in ChatGPT-Schulungen zu investieren, wenn das Tool doch immer einfacher wird?

Genau das ist der Trugschluss: Die Oberfläche wird einfacher, aber die Möglichkeiten werden komplexer. GPT-5.4 kann Dinge, die vor einem Jahr undenkbar waren – Excel-Modelle bauen, eigenständig recherchieren, Bildschirminhalte auswerten. Ohne Schulung nutzen die meisten davon nichts. Die Investition in Training zahlt sich nicht durch das Erlernen der Benutzeroberfläche aus, sondern dadurch, dass Mitarbeitende verstehen, welche Arbeit sie an die KI abgeben können und welche nicht. chatgpt-trainings.de vermittelt genau diese Urteilskompetenz.

ChatGPT kann jetzt meinen Bildschirm steuern – ist das für den Unternehmenseinsatz überhaupt sicher?

Die Computer-Use-Funktion ist aktuell über die API und Codex verfügbar, nicht direkt in der ChatGPT-Oberfläche für Endanwender. Für den Unternehmenseinsatz heißt das: Die Technologie existiert, aber sie erfordert eine bewusste Entscheidung, sie zu aktivieren, und klare Richtlinien, in welchem Rahmen sie genutzt wird. Das ist weniger eine Sicherheitsfrage als eine Governance-Frage. chatgpt-trainings.de hilft Unternehmen dabei, solche neuen Fähigkeiten einzuordnen und Richtlinien zu entwickeln, bevor sie unkontrolliert im Arbeitsalltag landen.

Wir nutzen ChatGPT Team – bekommen wir GPT-5.4 automatisch oder müssen wir upgraden?

GPT-5.4 Thinking ist für ChatGPT Plus, Team und Pro verfügbar. Wenn Sie bereits eine Team-Lizenz haben, können Ihre Mitarbeitenden GPT-5.4 Thinking sofort nutzen – es erscheint als Modellauswahl in der ChatGPT-Oberfläche. Die erweiterte Pro-Version mit höheren Nutzungslimits erfordert ein Upgrade auf den Pro-Plan. chatgpt-trainings.de berät bei der Lizenzwahl und zeigt in Workshops, welche Funktionen welchen Plan erfordern – damit Sie nicht mehr bezahlen, als Ihr Team tatsächlich braucht.

Unsere Mitarbeiter klagen, dass ChatGPT trotz des neuen Modells immer noch Fehler macht – wie gehen wir damit um?

GPT-5.4 produziert laut OpenAI ein Drittel weniger Falschaussagen als sein Vorgänger. Das ist ein deutlicher Fortschritt, bedeutet aber auch: Fehler passieren weiterhin. Der entscheidende Unterschied liegt nicht im Modell, sondern in der Kompetenz der Anwender. Wer gelernt hat, Ergebnisse kritisch zu prüfen, Prompts präzise zu formulieren und die Thinking-Funktion gezielt einzusetzen, bekommt bessere Ergebnisse. chatgpt-trainings.de vermittelt diese Prüf- und Promptkompetenz in praxisnahen Workshops – denn ein leistungsfähigeres Modell macht kompetente Nutzer nicht überflüssig, sondern wertvoller.