ChatGPT im Unternehmen DSGVO-konform nutzen: Was wirklich nötig ist

Wie Unternehmen ChatGPT datenschutzkonform einsetzen: Lizenzwahl, Auftragsverarbeitung, Schatten-KI eindämmen und EU-Datenresidenz nutzen.

In fast jedem Unternehmen, das ich berate, zeigt sich dasselbe Muster: Die offizielle Haltung zu ChatGPT ist entweder Schweigen oder ein vages Verbot – während die tatsächliche Nutzung längst im Alltag angekommen ist. Mitarbeitende formulieren E-Mails mit der Gratisversion, fassen Protokolle zusammen, lassen sich Angebote vorbereiten. Oft mit Kundennamen und Projektdetails im Prompt. Nicht aus Böswilligkeit, sondern weil niemand ihnen eine bessere Alternative gegeben hat. Die Frage, ob ChatGPT in Unternehmen DSGVO-konform nutzbar ist, hat sich damit von einer theoretischen Rechtsdebatte in ein operatives Problem verwandelt, das täglich wächst.

Was das Thema so dringlich macht, ist nicht die Komplexität der Rechtslage – die ist handhabbar, wenn man sich einmal ernsthaft damit beschäftigt. Dringlich ist die Kluft zwischen dem, was Unternehmen offiziell regeln, und dem, was im Arbeitsalltag passiert. In den meisten Organisationen klafft diese Lücke weit auseinander, und mit jedem Monat ohne klare Entscheidung wird sie größer.

Das eigentliche Problem heißt nicht DSGVO

Wer sich mit ChatGPT und Datenschutz beschäftigt, stößt schnell auf eine Flut an Rechtstexten, Checklisten und Abkürzungen: AVV, DSFA, TOM, DPF. Das klingt abschreckend und verleitet dazu, das Thema entweder an die Rechtsabteilung zu delegieren oder zu ignorieren. Beides ist keine gute Strategie.

Das tatsächliche Problem liegt woanders. Es liegt nicht darin, dass OpenAI keine datenschutzkonformen Produkte anbietet – das tun sie inzwischen durchaus. Es liegt darin, dass die meisten Unternehmen keine Entscheidung treffen. Sie haben weder offiziell erlaubt noch verboten, dass Mitarbeitende ChatGPT nutzen. Sie haben keinen Vertrag mit OpenAI. Sie haben keine Richtlinie. Und trotzdem fließen täglich Unternehmensdaten in ein System, über das die IT keine Kontrolle hat.

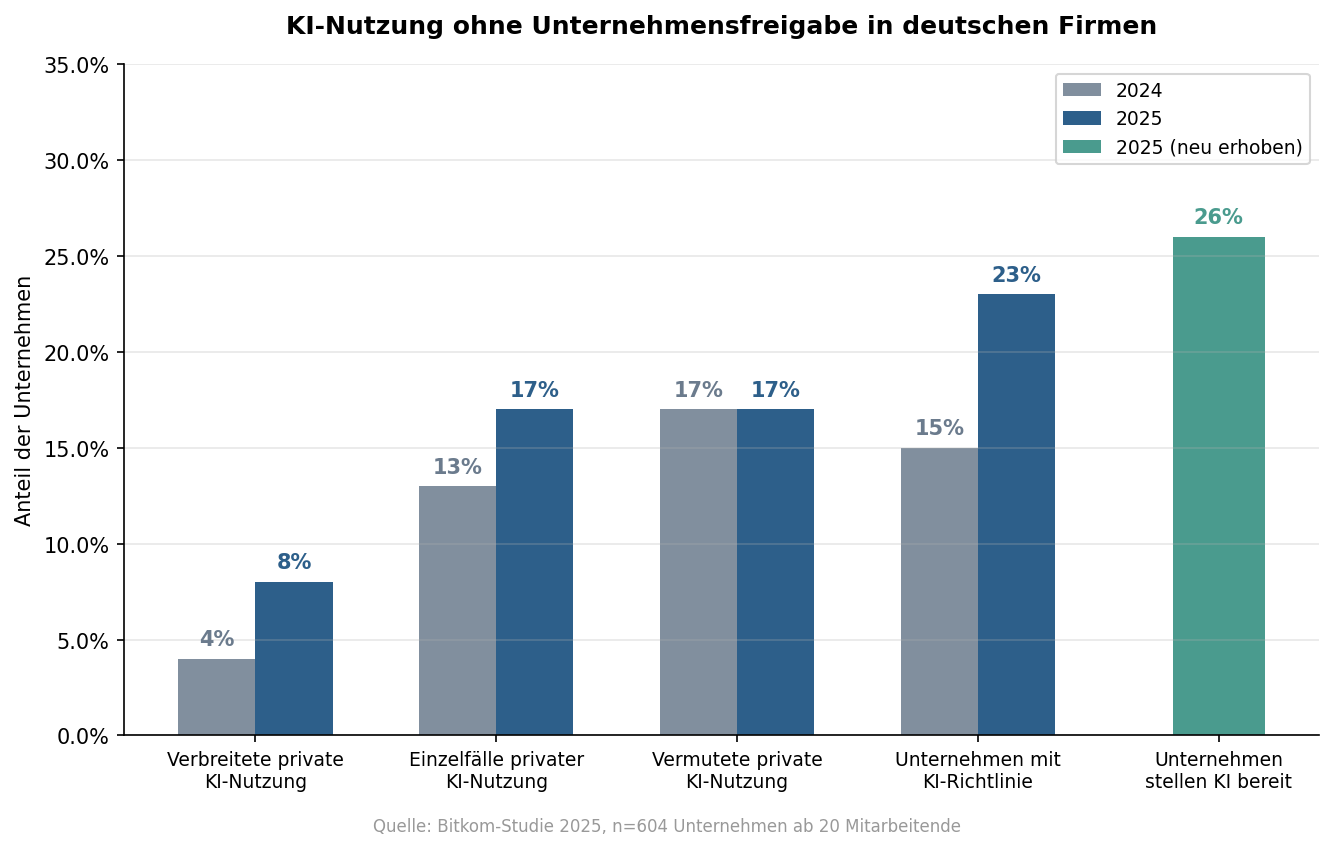

Laut einer Bitkom-Studie aus dem Jahr 2025 gehen 42 Prozent der deutschen Unternehmen davon aus, dass Beschäftigte KI-Tools über private Accounts für berufliche Zwecke verwenden. In 8 Prozent der befragten Firmen ist diese Nutzung nach eigener Einschätzung verbreitet – doppelt so viel wie ein Jahr zuvor. Gleichzeitig haben nur 23 Prozent eine KI-Richtlinie etabliert. Das heißt: In mehr als drei Viertel aller Unternehmen gibt es keinerlei formalen Rahmen für etwas, das längst zum Arbeitsalltag gehört.

Ich sage es offen: Die 42 Prozent aus der Bitkom-Studie halte ich für massiv untertrieben. Wir haben das Jahr 2026. Nach hunderten Gesprächen in meinen Trainings und Beratungen bin ich überzeugt, dass in praktisch jedem Unternehmen ab zehn Mitarbeitenden einzelne Leute im Team sitzen, die ChatGPT oder ein vergleichbares Tool nutzen – ob offiziell erlaubt oder nicht. Diese Technologie ist schlicht zu verlockend, als dass sich technikaffine Mitarbeitende von einer fehlenden Nutzungsregelung davon abhalten ließen, sich im Arbeitsalltag helfen zu lassen. Wer glaubt, dass das eigene Unternehmen die Ausnahme ist, macht sich etwas vor. Der Grad an Naivität seitens mancher Verantwortlicher wäre wirklich niedlich, wenn das Thema nicht so ernst wäre.

Welche Lizenz was darf – und was nicht

OpenAI bietet mittlerweile mehrere Lizenzmodelle an, die sich in ihren Datenschutz-Eigenschaften erheblich unterscheiden. Die Gratisversion und ChatGPT Plus sind für den Unternehmenseinsatz mit personenbezogenen Daten schlicht ungeeignet. Nicht weil sie technisch schlecht wären, sondern weil OpenAI bei diesen Tarifen keinen Auftragsverarbeitungsvertrag anbietet und sich vorbehält, Nutzereingaben zum Training seiner Modelle zu verwenden. Wer Kundennamen, Projektinterna oder Personaldaten in einen Plus-Account eingibt, hat damit ein DSGVO-Problem, das sich nicht wegkonfigurieren lässt.

Anders sieht es bei ChatGPT Team, Enterprise und der API aus. Bei allen drei Varianten agiert OpenAI als Auftragsverarbeiter im Sinne der DSGVO. Es gibt einen abschließbaren AVV – bei OpenAI heißt das Dokument "Data Processing Addendum" –, und die eingegebenen Daten werden nicht zum Modelltraining herangezogen. Das ist die Grundvoraussetzung für jeden ernsthaften Unternehmenseinsatz.

Zwischen Team und Enterprise gibt es trotzdem relevante Unterschiede. Team eignet sich für kleinere Organisationen und bietet die wesentlichen Datenschutz-Grundlagen: AVV, kein Training auf den Daten, Verwaltungskonsole für Nutzer. Enterprise geht weiter: SSO-Integration, granulare Administrationskontrolle und – seit Anfang 2026 – die Möglichkeit, EU-Datenresidenz zu aktivieren. Das bedeutet, dass nicht nur die gespeicherten Daten, sondern auch die GPU-Verarbeitung auf europäischen Servern stattfindet. Für Unternehmen in regulierten Branchen kann das den entscheidenden Unterschied machen.

Allerdings ist Enterprise kein Angebot für jedermann. OpenAI veröffentlicht keine festen Preise – die Konditionen werden individuell verhandelt. Nach allem, was aus dem Markt bekannt ist, liegt der Preis bei rund 60 US-Dollar pro Nutzer und Monat, bei einer Mindestabnahme von etwa 150 Lizenzen und einem verbindlichen Jahresvertrag. Das ergibt ein jährliches Mindestinvestment von über 100.000 Dollar, bevor überhaupt ein einziger Prompt geschrieben wurde. Für Konzerne ist das überschaubar, für den Mittelstand oft eine Hürde, die Team – oder eben die Microsoft-Alternative – zur pragmatischeren Wahl macht.

Die oft übersehene Alternative: Microsoft 365 Copilot Chat

Was in der Debatte um ChatGPT-Lizenzen erstaunlich oft untergeht: Viele Unternehmen haben die datenschutzkonforme KI-Lösung bereits im Haus, ohne es zu wissen. Wer Microsoft-365-Lizenzen für seine Mitarbeitenden besitzt, kann den kostenlosen Copilot Chat ausrollen – ohne zusätzliche Kosten, ohne separaten AVV mit einem US-Startup, und ohne die Debatte über Datenresidenz. Copilot Chat läuft in der privaten Cloud des Unternehmens, innerhalb der bestehenden Microsoft-Compliance-Grenze. Die Daten bleiben dort, wo sie hingehören: im Tenant des Unternehmens.

Damit ist das Datenschutzproblem allerdings nur zur Hälfte gelöst. Denn auch ein technisch sicheres Tool schützt nicht vor falscher Bedienung. Mitarbeitende müssen verstehen, wie sie Prompts formulieren, welche Daten sie in welchem Kontext verwenden dürfen und wo die Grenzen des Systems liegen – nicht weil die Technik unsicher wäre, sondern weil Compliance-Verstöße auch innerhalb einer geschützten Umgebung passieren können, etwa wenn KI-generierte Inhalte ungeprüft an Kunden gehen oder automatisierte Entscheidungen ohne menschliche Aufsicht getroffen werden. Wer das Potenzial von Copilot Chat tatsächlich heben will, kommt um eine fundierte Einweisung in die neuen Arbeitsweisen nicht herum. Für Unternehmen, die Microsoft 365 Copilot strategisch einführen möchten – von der Lizenzberatung über Governance bis zum Teamtraining – ist die Copilotenschule die spezialisierte Anlaufstelle im deutschsprachigen Raum.

AVV, EU-Datenresidenz und was das praktisch bedeutet

Den Auftragsverarbeitungsvertrag mit OpenAI abzuschließen ist technisch unkompliziert – er ist standardisiert und steht als DPA auf der OpenAI-Website zum Download bereit. Allerdings reicht der bloße Abschluss nicht. Die DSGVO verlangt, dass das Unternehmen als Verantwortlicher dokumentiert, welche Daten zu welchem Zweck verarbeitet werden, dass eine Datenschutz-Folgenabschätzung durchgeführt wurde und dass technisch-organisatorische Maßnahmen implementiert sind. Das klingt nach viel Bürokratie, ist aber im Kern ein strukturierter Denkprozess: Was geben wir ein? Warum? Welche Risiken entstehen? Und wie begrenzen wir sie?

Die EU-Datenresidenz, die OpenAI seit Januar 2026 für Enterprise-Kunden anbietet, ist ein willkommener Fortschritt, aber kein Allheilmittel. Denn selbst wenn Daten in Europa verarbeitet werden, bleibt OpenAI ein US-Unternehmen, das dem CLOUD Act unterliegt. US-Behörden können theoretisch Herausgabe verlangen – unabhängig davon, wo die Server stehen. Für die meisten Unternehmen ist dieses Restrisiko vertretbar, zumal das EU-US Data Privacy Framework den Datentransfer aktuell legitimiert und OpenAI dort zertifiziert ist. Wer aber in hochregulierten Bereichen arbeitet – Gesundheitswesen, Steuerberatung, Wirtschaftsprüfung – sollte diesen Punkt mit dem eigenen Datenschutzbeauftragten sorgfältig bewerten.

Was übrigens gerne übersehen wird: Auch bei aktivierter EU-Residenz verarbeitet OpenAI bestimmte Metadaten weiterhin global – etwa Workspace-Namen, Abrechnungsdaten und Authentifizierungsinformationen. Das ist kein Dealbreaker, sollte aber in der Datenschutz-Folgenabschätzung stehen.

Schatten-KI: Das unsichtbare Compliance-Risiko

Wenn ich Unternehmen frage, was ihr größtes Datenschutzrisiko im Zusammenhang mit KI ist, kommt fast immer die gleiche Antwort: der Datentransfer in die USA, die Modellarchitektur, die Frage, ob OpenAI vertrauenswürdig ist. All das sind berechtigte Punkte. Aber sie verkennen, wo das akuteste Problem liegt.

Das größte DSGVO-Risiko in den meisten Organisationen ist Schatten-KI. Mitarbeitende, die ChatGPT über ihre privaten Accounts nutzen, weil das Unternehmen keine Alternative bereitstellt. Ohne AVV. Ohne Logging. Ohne irgendeine Form von Governance. In diesen Fällen ist nicht OpenAI das Problem – OpenAI macht transparent, was mit den Daten passiert. Das Problem ist, dass niemand im Unternehmen weiß, welche Daten wohin fließen.

Die Bitkom-Zahlen zeigen, dass nur 26 Prozent der Unternehmen ihren Mitarbeitenden offiziell Zugang zu generativer KI geben. Bei Firmen mit weniger als 100 Beschäftigten sind es sogar nur 23 Prozent. Das erzeugt eine absurde Dynamik: Die Nutzung steigt, aber die offizielle Bereitstellung hinkt hinterher. Je länger ein Unternehmen wartet, desto tiefer gräbt sich die unkontrollierte Nutzung in den Arbeitsalltag ein – und desto schwieriger wird es, sie hinterher in geregelte Bahnen zu lenken.

Die unbequeme Wahrheit lautet: Ein Verbot von ChatGPT funktioniert in der Praxis nicht. Es verschiebt die Nutzung nur dorthin, wo sie noch weniger kontrollierbar ist – auf private Geräte, in private Browser-Profile, in Messenger-Apps. Der einzige Weg, Schatten-KI einzudämmen, ist, eine attraktive, offiziell genehmigte Alternative anzubieten und gleichzeitig klare Regeln aufzustellen.

Eine KI-Richtlinie, die funktioniert

Viele Unternehmen reagieren auf die Datenschutzfrage, indem sie eine KI-Richtlinie erstellen. Das ist richtig und notwendig. Aber eine Richtlinie, die nur aus Verboten und Juristensprache besteht, wird von Mitarbeitenden exakt so behandelt wie die meisten IT-Richtlinien: gelesen wird sie einmal, befolgt wird sie selten, verstanden wird sie nie.

Eine wirksame KI-Richtlinie braucht drei Eigenschaften. Erstens muss sie konkret sein. Nicht "personenbezogene Daten dürfen nicht eingegeben werden", sondern: "Gib keine Kundennamen, E-Mail-Adressen, Bestellnummern oder internen Projekttitel in ChatGPT ein. Wenn du Texte zusammenfassen willst, die solche Daten enthalten, anonymisiere sie vorher." Zweitens muss sie Alternativen benennen. Was darf ich stattdessen tun? Welche Daten sind unproblematisch? Drittens – und das wird fast immer vergessen – muss sie trainiert werden. Eine Richtlinie, die per E-Mail verschickt und als PDF auf dem Intranet abgelegt wird, verändert kein Verhalten.

Was wir in unseren Trainings regelmäßig sehen: Sobald Mitarbeitende verstehen, wie ChatGPT Daten verarbeitet – also wirklich verstehen, nicht nur eine Checkbox unterschreiben –, verändert sich ihr Umgang mit dem Tool spürbar. Nicht weil sie Angst haben, sondern weil sie informierte Entscheidungen treffen können. Datenschutzkompetenz ist keine Bremse für Produktivität. Sie ist die Voraussetzung dafür, dass produktive Nutzung überhaupt erlaubt werden kann.

Der EU AI Act: Was ab August 2026 zusätzlich gilt

Als wäre die DSGVO nicht komplex genug, kommt mit dem EU AI Act ein zweites Regelwerk hinzu, dessen erste Pflichten bereits seit Februar 2025 gelten und das bis August 2026 vollständig durchsetzbar wird. Für Unternehmen, die ChatGPT nutzen, sind vor allem zwei Punkte relevant.

Artikel 4 der KI-Verordnung verlangt, dass alle Mitarbeitenden, die KI-Systeme einsetzen, über eine angemessene KI-Kompetenz verfügen. Das ist keine vage Empfehlung, sondern eine Pflicht, die seit Februar 2025 gilt. Was "angemessen" bedeutet, ist absichtlich nicht starr definiert – es hängt vom Einsatzkontext ab. Aber ein Unternehmen, das ChatGPT im Kundenkontakt, in der Personalarbeit oder in der Finanzanalyse einsetzt, ohne seine Mitarbeitenden geschult zu haben, handelt schlicht nicht rechtskonform.

Der zweite wichtige Punkt betrifft die Hochrisiko-Einstufung. Ab August 2026 gelten für KI-Anwendungen in Bereichen wie Personalauswahl, Kreditvergabe, Bildung oder kritische Infrastruktur strenge Anforderungen an Transparenz, Dokumentation und menschliche Aufsicht. Wenn ein Unternehmen ChatGPT nutzt, um Bewerbungen vorzufiltern oder Leistungsbeurteilungen vorzubereiten, kann das unter diese Kategorie fallen. Die Konsequenz: deutlich mehr Dokumentationspflichten, Risikoanalysen und technische Prüfungen. Der AI Act ersetzt die DSGVO nicht – er ergänzt sie. Beides muss gleichzeitig beachtet werden, und beides erfordert, dass die Menschen, die mit den Werkzeugen arbeiten, wissen, was sie tun.

Was Unternehmen jetzt konkret tun sollten

Nach all den Paragraphen und Pflichten stellt sich die Frage: Wo fängt man an? Aus meiner Erfahrung mit dutzenden Unternehmen, die diesen Prozess durchlaufen haben, hat sich eine Reihenfolge bewährt, die pragmatisch ist, ohne wichtige Schritte auszulassen.

Der erste Schritt ist eine ehrliche Bestandsaufnahme. Nicht als Kontrollaktion, sondern als Grundlage für alles Weitere. Welche KI-Tools werden im Unternehmen genutzt? Von wem? Über welche Accounts? Mit welchen Daten? In den meisten Fällen bringt schon eine anonyme Kurzumfrage mehr Klarheit als erwartet – und liefert gleichzeitig Argumente für die Investition in eine ordentliche Lizenz.

Danach folgt die Lizenzentscheidung. Für Unternehmen mit bis zu 150 Nutzern ist ChatGPT Team in den meisten Fällen ausreichend. Ab einer bestimmten Größe oder bei besonderen Anforderungen – SSO, EU-Datenresidenz, Compliance-Reporting – wird Enterprise relevant. In jedem Fall muss der AVV abgeschlossen werden. Das ist ein Formular, kein Verhandlungsmarathon.

Parallel dazu entsteht die KI-Richtlinie. Kurz, konkret, mit Beispielen. Was darf eingegeben werden? Was nicht? Wo findet man Hilfe? Was passiert bei Unsicherheit? Die Richtlinie deckt gleichzeitig Anforderungen aus DSGVO (Artikel 32: technisch-organisatorische Maßnahmen) und AI Act (Artikel 4: KI-Kompetenz) ab und ist der einfachste Weg, beide Pflichten nachweisbar zu erfüllen.

Und dann kommt der Schritt, den die meisten unterschätzen: das Training. Nicht ein halbstündiges Webinar mit Datenschutz-Folien, sondern eine echte Befähigung, die Anwendern zeigt, wie sie ChatGPT produktiv und regelkonform einsetzen. Wer versteht, warum bestimmte Daten nicht in den Prompt gehören, hält sich an die Regeln – nicht aus Pflichtgefühl, sondern aus Einsicht.

Häufig gestellte Fragen

Unsere Mitarbeiter nutzen ChatGPT bereits privat für die Arbeit – wie bekommen wir das datenschutzrechtlich in den Griff?

Das ist die häufigste Situation, die wir in Unternehmen antreffen: Die Nutzung ist längst da, nur eben unkontrolliert. Der erste Schritt ist eine ehrliche Bestandsaufnahme – nicht als Kontrollinstrument, sondern um zu verstehen, welche Tools im Einsatz sind und welche Daten dorthin fließen. Danach braucht es eine passende Lizenz (mindestens ChatGPT Team mit AVV), eine verständliche KI-Richtlinie und ein Training, das Mitarbeitende nicht gängelt, sondern befähigt. chatgpt-trainings.de begleitet Unternehmen genau bei dieser Überführung von Schatten-KI in eine geordnete, DSGVO-konforme Nutzung – vom Erstgespräch bis zur Teamschulung.

Reicht ChatGPT Enterprise für die DSGVO-Konformität, oder brauchen wir trotzdem noch weitere Maßnahmen?

ChatGPT Enterprise ist ein guter Ausgangspunkt, aber kein Freifahrtschein. Die Lizenz allein macht Sie nicht DSGVO-konform. Sie brauchen zusätzlich einen abgeschlossenen Auftragsverarbeitungsvertrag (den OpenAI als Data Processing Addendum anbietet), eine dokumentierte Datenschutz-Folgenabschätzung, technisch-organisatorische Maßnahmen und geschulte Mitarbeitende, die wissen, welche Daten sie eingeben dürfen und welche nicht. chatgpt-trainings.de hilft dabei, diese Anforderungen pragmatisch umzusetzen – mit Workshops, die Datenschutz- und IT-Verantwortliche ebenso einbeziehen wie die Anwender selbst.

Wie überzeuge ich unsere Geschäftsleitung, in eine ordentliche ChatGPT-Lizenz zu investieren statt die Gratisversion zu dulden?

Das stärkste Argument ist das Risiko, das bereits besteht: Wenn Mitarbeitende die kostenlose Version nutzen, fließen potenziell Firmendaten ins Modelltraining von OpenAI – ohne AVV, ohne Kontrolle, ohne Rechtsgrundlage. Ein einziger Datenschutzvorfall kann teurer werden als zehn Jahre Teamlizenzen. Gleichzeitig ermöglicht eine Business-Lizenz den produktiven Einsatz, der messbare Zeitersparnis bringt. chatgpt-trainings.de bereitet solche Entscheidungsvorlagen für Geschäftsleitungen auf und liefert die passenden Schulungen gleich mit.

Wir sind ein mittelständisches Unternehmen – brauchen wir wirklich ChatGPT Enterprise oder reicht Team?

Für die meisten mittelständischen Unternehmen ist ChatGPT Team bereits eine solide Wahl: Sie bekommen einen Auftragsverarbeitungsvertrag, Daten werden nicht für das Modelltraining verwendet, und die Kosten sind überschaubar. Enterprise wird dann relevant, wenn Sie EU-Datenresidenz benötigen, SSO-Integration brauchen oder mehr als 150 Nutzer verwalten. chatgpt-trainings.de berät Unternehmen bei der Lizenzwahl und hilft dabei, die technischen Anforderungen mit den datenschutzrechtlichen Pflichten abzugleichen – unabhängig von der Unternehmensgröße.

Was ändert sich durch den EU AI Act für unsere ChatGPT-Nutzung im Unternehmen?

Der EU AI Act ergänzt die DSGVO um neue Pflichten, die ab August 2026 in vollem Umfang gelten. Für die meisten Unternehmen bedeutet das vor allem: eine dokumentierte KI-Kompetenz der Mitarbeitenden nach Artikel 4, Transparenz darüber, wo KI zum Einsatz kommt, und – falls Sie ChatGPT in risikoreichen Bereichen wie Personalauswahl einsetzen – deutlich strengere Anforderungen an Dokumentation und menschliche Aufsicht. chatgpt-trainings.de integriert die Anforderungen des AI Act in seine Schulungen, damit Unternehmen nicht erst reagieren müssen, wenn die Aufsichtsbehörde klopft.